A OpenAI introduziu recentemente uma ferramenta de IA para geração de vídeos chamada “Sora” para usuários do ChatGPT Plus e Pro. Mas esta não é a primeira ferramenta desse tipo. Na verdade, hoje em dia há muitos serviços que oferecem suporte à criação de vídeos baseados em inteligência artificial de forma extremamente rápida. Eles estão gradualmente se tornando um assistente poderoso para criadores, mas às vezes confusos para os espectadores porque geralmente é difícil determinar quais vídeos são reais ou quais clipes são criados por IA.

Como o mercado de criação de vídeos com IA cresce rapidamente a cada dia, detectar vídeos falsos ou gerados por IA online está se tornando cada vez mais difícil. Para ajudar a resolver esse problema, a Meta introduziu uma ferramenta de marca d'água chamada “Meta Video Seal”, que funciona adicionando uma marca d'água ao conteúdo de vídeo gerado por IA.

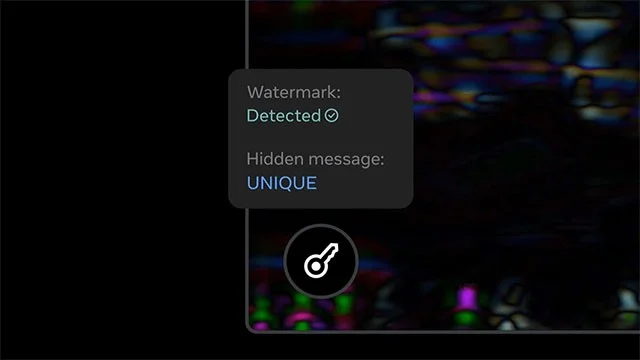

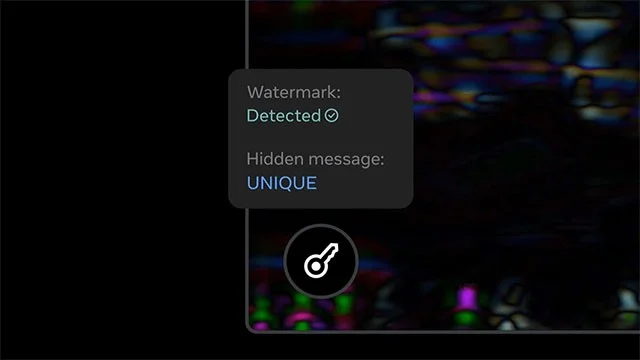

De acordo com a Meta, adicionar marcas d'água a vídeos gerados por IA não terá muito impacto na experiência do usuário. Marcas d'água também podem ser incorporadas diretamente sem afetar a aparência geral do vídeo. Além disso, o Video Seal também pode adicionar mensagens ocultas aos vídeos, que podem ser detectadas para rastrear a origem do vídeo.

A característica especial do "Meta Video Seal" é sua capacidade de "resistir" aos esforços comuns de edição de vídeo, incluindo algoritmos de desfoque, corte ou compressão para facilitar o compartilhamento online. Isso significa que se alguém editar um vídeo contendo uma marca d'água usando o Meta Video Seal, a marca d'água permanecerá intacta, ajudando a verificar a autenticidade e a origem do vídeo.

A Meta está implantando a ferramenta sob uma licença autorizada, juntamente com documentação de treinamento e código de inferência. Há também uma demonstração interativa para que qualquer pessoa possa experimentar o modelo.

“Embora as ferramentas de IA possam ajudar a aproximar o mundo, é importante implementarmos salvaguardas para mitigar o risco de imitação, manipulação e outras formas de uso indevido que possam prejudicar seus benefícios”, disse Meta. “A ‘marca d’água’ em vídeos gerados por IA é um passo importante para uma melhor rastreabilidade de conteúdo e modelos de IA.”

Com o Video Seal, a Meta pretende dificultar que pessoas mal-intencionadas explorem a IA para espalhar notícias falsas. Embora a IA possa fazer coisas incríveis e tornar conteúdo útil mais acessível, também há certas barreiras que precisam ser colocadas em prática para garantir que informações precisas estejam disponíveis para todos.